GPT-5.4 출시, 엇갈리는 반응: 컴퓨터 사용은 1등, 코딩은 뒤처졌다

OpenAI가 GPT-5.4를 출시했다. 컴퓨터 사용과 에이전트 분야에서 인간을 초월하는 성과를 보였지만, 핵심 코딩 벤치마크에서는 Claude Opus 4.6에 밀리고 SWE-bench Verified 결과는 공개조차 하지 않았다. 1년 전 압도적 1등이었던 OpenAI, 이제는 어디에 서 있는가.

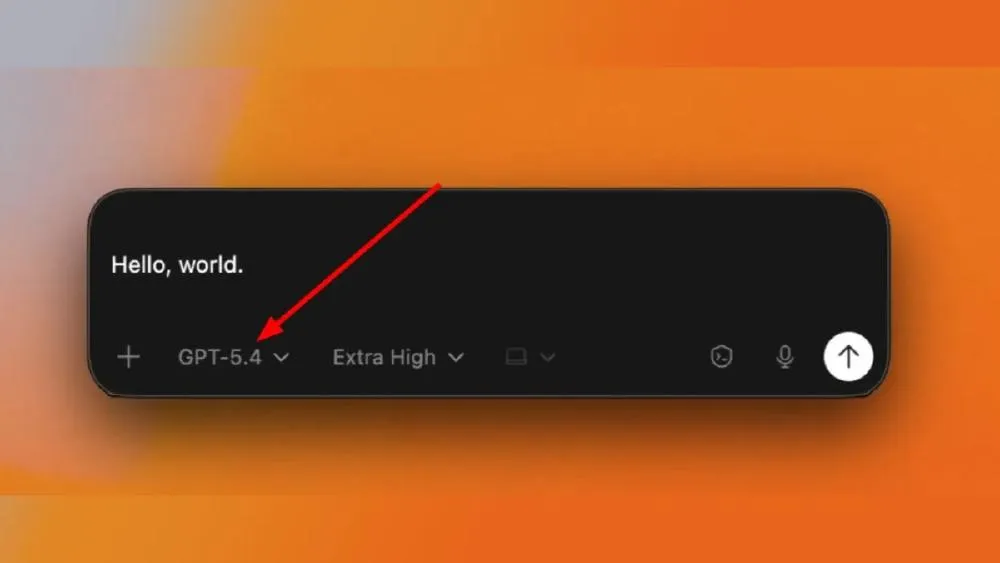

2026년 3월 5일, OpenAI가 GPT-5.4를 공식 출시했다. 기본 모델, Pro, Thinking 세 가지 버전으로 나뉘며, 네이티브 컴퓨터 사용 기능과 1M 토큰 컨텍스트 윈도우를 탑재한 것이 핵심이다. GPT-5.4는 분명 인상적인 모델이다. 그러나 1년 전처럼 모든 벤치마크를 휩쓸던 시절과는 다르다.

OpenAI는 이번에도 화려한 벤치마크 수치를 내걸었지만, 정작 가장 유명한 코딩 벤치마크인 SWE-bench Verified 결과는 빠져 있었다. 코딩에서는 Claude Opus 4.6에, 추론에서는 Gemini 3.1 Pro에 밀리는 현실. 에이전트와 컴퓨터 사용에서는 확실한 강점을 보이지만, '절대 강자'라는 타이틀은 이미 과거의 것이 되었다.

1. GPT-5.4 핵심 기능: 네이티브 컴퓨터 사용과 Tool Search

GPT-5.4의 가장 주목할 만한 신기능은 네이티브 컴퓨터 사용이다. Playwright 기반으로 스크린샷을 읽고, 마우스와 키보드 명령을 실행하며, 여러 애플리케이션을 넘나들며 작업을 자동화할 수 있다. OpenAI는 이를 "범용 모델 최초의 네이티브 컴퓨터 사용"이라 소개했다.

OSWorld-Verified 벤치마크에서 GPT-5.4는 75.0%를 기록했다. 인간 성과 기준인 72.4%를 넘어선 수치로, 전작 GPT-5.2의 47.3%에서 대폭 뛰어올랐다. 데스크톱 환경에서 AI가 인간보다 더 정확하게 작업을 수행할 수 있다는 의미다.

두 번째 주요 기능은 Tool Search다. 기존에는 모든 도구 정의를 프롬프트에 함께 넣어야 했지만, Tool Search를 통해 필요한 도구만 온디맨드로 로딩할 수 있게 됐다. 이로써 토큰 사용량이 47% 절감됐다. 개발자 입장에서는 비용 절감과 효율성 개선이 동시에 이루어진 셈이다.

그 외에도 1M 토큰 컨텍스트 윈도우(272K 초과 시 2배 과금), 할루시네이션 33% 감소, 전체 응답 오류 18% 감소 등이 개선 포인트로 제시됐다. 전문 업무 벤치마크인 GDPval에서는 83.0%를 기록해 전작의 70.9%를 크게 앞질렀다.

2. SWE-bench Verified 미공개 논란: 유리한 벤치마크만 골랐나

GPT-5.4 발표에서 가장 논란이 된 부분은 SWE-bench Verified 결과의 부재다. AI 코딩 능력을 측정하는 대표 벤치마크로 모든 주요 AI 기업이 경쟁해온 SWE-bench Verified에서, OpenAI는 GPT-5.4 결과를 아예 공개하지 않았다.

배경이 있다. OpenAI는 2026년 2월 23일, SWE-bench Verified에 대한 평가를 중단하겠다고 선언했다. 자체 감사 결과 조사한 테스트 케이스의 59.4%가 결함이 있는 것으로 드러났다는 이유였다. 또한 학습 데이터 오염 문제도 지적했는데, 모든 프론티어 모델이 원본 인간 작성 버그 수정 코드를 그대로 재현할 수 있었다는 것이다.

대신 OpenAI는 Scale AI가 개발한 SWE-bench Pro에서만 결과를 발표했다. 그런데 문제는 성적이다. GPT-5.4의 SWE-bench Pro 점수는 57.7%로, 전작 GPT-5.3-Codex의 56.8%에서 겨우 0.9%p 개선에 불과했다. SWE-bench Verified에서 80.8%를 기록한 Claude Opus 4.6과의 격차는 여전히 뚜렷하다.

비판론자들은 OpenAI가 자사에 불리한 벤치마크를 "결함이 있다"며 버리고, 유리한 벤치마크로 옮겨간 전형적인 cherry-picking이라고 지적한다. 물론 SWE-bench Verified의 구조적 문제 자체는 사실이지만, 가장 성적이 좋지 않은 시점에 퇴출을 선언한 타이밍이 의심스럽다는 것이다.

3. 벤치마크 SOTA 경쟁: 모든 분야의 1등은 없다

2026년 3월 현재, AI 벤치마크 지형은 완전히 분산됐다. 어떤 단일 모델도 모든 영역에서 1위를 차지하지 못하고 있다. 코딩 분야에서는 Claude Opus 4.6이 SWE-bench Verified 80.8%로 확실한 1위다. 추론에서는 Gemini 3.1 Pro가 GPQA Diamond 94.3%로 선두를 달리고 있다.

GPT-5.4가 강한 영역은 에이전트와 컴퓨터 사용이다. OSWorld-Verified 75.0%로 인간 수준을 넘어섰고, Toolathlon 에이전트 벤치마크에서도 54.6%로 Claude(44.8%)를 크게 앞섰다. 전문 업무(GDPval 83.0%)에서도 독보적이다.

고난이도 추론 벤치마크 ARC-AGI-2에서는 GPT-5.4 Pro가 83.3%로 Gemini 3.1 Pro(77.1%)와 Claude Opus 4.6(75.2%)을 앞섰다. 하지만 이 성적은 가장 비싼 Pro 모델에서만 나온 수치로, 일반 사용자가 접근하기 어렵다.

결론적으로 코딩은 Claude, 추론은 Gemini, 에이전트/컴퓨터 사용은 GPT-5.4라는 삼파전 구도가 형성됐다. "모든 벤치마크를 지배하는 단일 승자는 없다"는 것이 현재 AI 업계의 현실이다.

4. 1년 전의 압도적 1등, 어디로 갔나

GPT-4o 시절을 기억하는가. 2024년 중반, OpenAI는 거의 모든 벤치마크에서 독보적 1위를 차지하고 있었다. 코딩, 추론, 창작, 도구 사용 어느 분야든 ChatGPT가 기준점이었고, 경쟁사들은 그 뒤를 쫓았다.

그러나 Anthropic이 Claude 3.5 Sonnet을 시작으로 Claude 4, 그리고 Opus 4.6까지 빠르게 진화하며 코딩 분야에서 역전에 성공했다. Google도 Gemini 2.0에서 3.1 Pro까지 추론과 가성비 면에서 맹추격하며 격차를 좁혔다. 2026년 현재, OpenAI는 모든 영역에서 1등을 내줬거나 근소한 차이로 경쟁 중이다.

더 심각한 문제는 신뢰도다. OpenAI가 자체 보고하는 벤치마크 수치에 대한 독립적 검증이 부족하다는 지적이 꾸준히 나온다. SWE-bench Verified를 자사에 불리해지자 퇴출시킨 사례, 벤치마크 선택의 편향성 등이 누적되면서, 수치 자체의 신뢰도에 물음표가 붙었다. Gizmodo는 이번 출시를 "절박하게 승리가 필요한 OpenAI"라고 표현했다.

마치며: 코드 레드 이후, 증명하지 못한 왕좌

2023년 말 Google의 Gemini 발표에 촉발된 OpenAI 내부 "코드 레드" 이후, OpenAI는 줄곧 추격당해 왔다. GPT-5 시리즈를 5.0에서 5.1, 5.2, 5.3을 거쳐 5.4까지 불과 7개월 만에 쏟아냈지만, 한 번도 모든 분야에서 SOTA를 탈환하지 못했다.

GPT-5.4는 컴퓨터 사용과 에이전트 분야에서 확실한 강점을 보여준다. OSWorld에서 인간을 넘어선 것은 실질적인 성과다. 하지만 핵심 코딩 벤치마크에서 Claude에 뒤처지고, SWE-bench Verified 결과조차 공개하지 않은 것은 약점을 인정한 것이나 다름없다.

AI 모델 경쟁은 이제 단일 왕좌를 두고 다투는 게임이 아니다. 코딩, 추론, 에이전트, 전문 업무 각각에서 서로 다른 모델이 앞서는 멀티폴라 시대가 열렸다. OpenAI 앞에 놓인 과제는 분명하다. GPT-5.4의 강점인 에이전트 역량을 살리면서, 코딩과 추론에서도 격차를 좁혀야 한다. 과거의 압도적 1등 자리로 돌아가는 길은, 여전히 험난해 보인다.

- OpenAI - Introducing GPT-5.4

- TechCrunch - OpenAI launches GPT-5.4 with Pro and Thinking versions

- Gizmodo - OpenAI in Desperate Need of a Win, Launches GPT-5.4

- The Decoder - OpenAI wants to retire the AI coding benchmark that everyone has been competing on

- DigitalApplied - GPT-5.4 vs Opus 4.6 vs Gemini 3.1 Pro: Best Frontier Model

- Every.to - Vibe Check: OpenAI Is Back

- IsItGoodAI - GPT-5.4 Review